Para developer Membuat Claude Berbicara Seperti Gua untuk Mengurangi Biaya—Dan Itu Berhasil

Singkatnya

- Seorang pengembang menemukan bahwa memaksa Claude berbicara seperti manusia gua memangkas token keluaran, dan karenanya biaya, hingga 75%.

- Internet langsung mengubahnya menjadi skill GitHub.

- Dengan biaya Anthropic yang begitu tinggi per token keluaran, mode grunt-mode jadi kurang lelucon dan lebih seperti strategi anggaran.

Di suatu tempat di antara rekayasa prompt dan seni pertunjukan, seorang pengembang memublikasikan penemuan di Reddit yang membuat komunitas AI tertawa sebelum benar-benar memperhatikan: ajarkan Claude berkomunikasi seperti manusia prasejarah dan lihat tagihan token Anda menyusut hingga 75%. Postingan itu masuk ke r/ClaudeAI minggu lalu dan sejak itu mengumpulkan lebih dari 400 komentar dan 10K suara—kombinasi yang jarang antara wawasan teknis yang nyata dan komedi absurd yang cenderung dihargai internet.

Mekanismenya sederhana. Alih-alih membiarkan Claude “pemanasan” dengan basa-basi, narasikan setiap langkah yang dilakukannya, lalu tutup dengan penawaran untuk membantu lebih lanjut; pengembang membatasi model pada kalimat-kalimat pendek yang sudah disederhanakan. Tool dulu, hasil dulu, tanpa penjelasan. Tugas penelusuran web normal yang biasanya berjalan sekitar 180 token keluaran turun menjadi kira-kira 45. Pemilik postingan asli mengklaim pengurangan keluaran hingga 75%, dicapai dengan membuat model terdengar seperti baru saja menemukan api.

Dalam istilah manusia gua, seperti kata salah satu redditor: "Why waste time say lot word when few word do trick?” Yang tidak disentuh oleh teknik ini adalah konteks input: seluruh riwayat percakapan, file yang terlampir, dan instruksi sistem yang dibaca ulang oleh model pada setiap giliran. Input semacam ini biasanya jauh lebih besar daripada output, terutama pada sesi coding yang lebih panjang. Dalam sesi dunia nyata yang menghitung semua input ini, penghematan sekitar 25%, bukan 75%. Tetap berarti, hanya saja bukan angka judul. Juga ide bagus untuk memberi model instruksi yang normal. Jangan memberinya obrolan “manusia gua” karena bisa merembet ke situasi “garbage in, garbage out”.

Ada juga pertanyaan tentang degradasi kecerdasan. Sejumlah peneliti di thread itu berargumen bahwa memaksa AI untuk menempati persona yang kurang canggih bisa secara aktif merusak kualitas penalarannya—bahwa batasan verbal mungkin merembet ke ranah kognitif. Kekhawatiran itu belum diselesaikan secara definitif, tetapi tetap layak dipertimbangkan saat mengevaluasi hasil. Skill bagus, skill jadi viral Terlepas dari catatan-catatan itu, teknik ini menemukan kehidupan kedua di GitHub hampir segera.

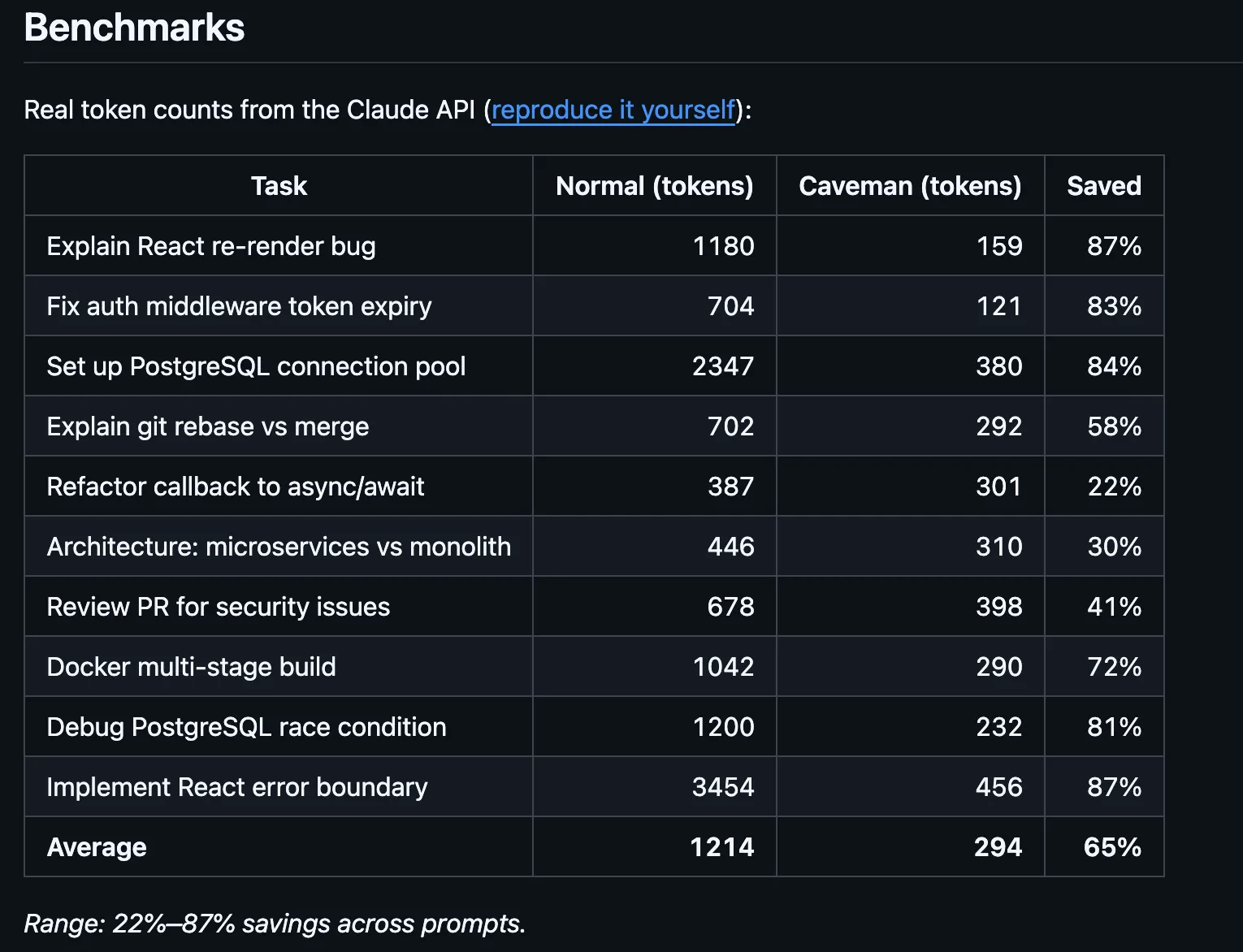

Pengembang Shawnchee mengemas aturan-aturan tersebut menjadi skill mandiri yang kompatibel dengan Claude Code, Cursor, Windsurf, Copilot, dan lebih dari 40 agen lainnya. Skill ini merangkum pendekatan itu menjadi 10 aturan: tidak ada frasa pengisi, eksekusi sebelum menjelaskan, tidak ada komentar meta, tidak ada pembuka, tidak ada penutup, tidak ada pengumuman tool, jelaskan hanya saat diperlukan, biarkan kode berbicara sendiri, dan perlakukan error sebagai hal yang harus diperbaiki, bukan untuk dinarasikan. Benchmark di repositori, diverifikasi dengan tiktoken, menunjukkan pengurangan token keluaran sebesar 68% pada tugas penelusuran web, 50% pada edit kode, dan 72% pada pertukaran tanya-jawab—untuk pengurangan keluaran rata-rata 61% di seluruh empat tugas standar. Repositori paralel oleh pengembang Julius Brussee mengambil pendekatan yang sedikit berbeda, dengan memformat ide yang sama sebagai file SKILL.md yang memiliki 562 bintang di GitHub. Spesifikasinya: respons seperti manusia gua yang pintar, potong artikel, frasa pengisi, dan basa-basi, pertahankan semua substansi teknis. Blok kode tetap tidak berubah. Pesan error dikutip persis. Istilah teknis tetap utuh. Manusia gua hanya berbicara bungkus bahasa Inggris di seputar fakta.

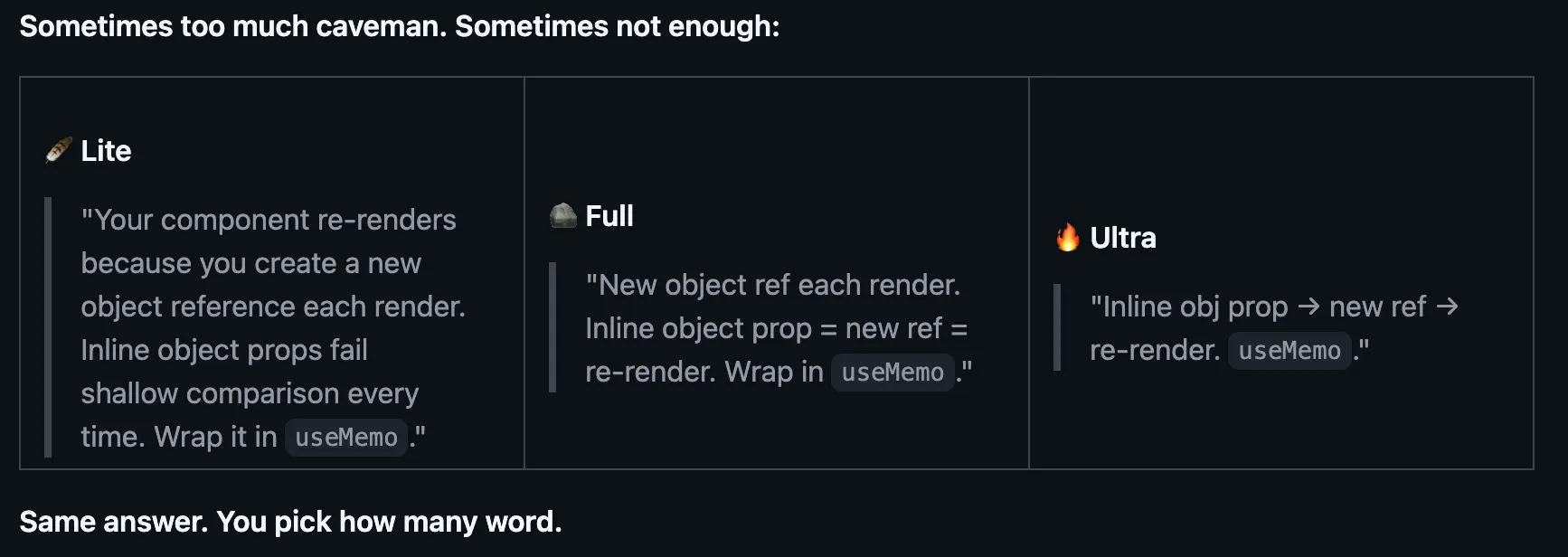

Yang ini bahkan hadir dengan mode berbeda untuk memengaruhi seberapa banyak Anda ingin menyederhanakan, dengan beralih antara Normal, Lite, dan Ultra. Model-model tersebut mengerjakan pekerjaan yang persis sama, tetapi memberikan jawaban yang jauh lebih singkat, sehingga menghasilkan penghematan besar dari waktu ke waktu.

Konteks biaya yang lebih luas membuat lelucon ini jadi lebih tajam. Anthropic termasuk di antara model yang paling mahal dalam hal harga per token. Bagi pengembang yang menjalankan workflow agenik dengan puluhan giliran per sesi, keluhan soal verbosity keluaran bukan masalah gaya. Itu masuk ke pos biaya. Jika grunt manusia gua bisa menggantikan ringkasan lima kalimat tentang apa yang baru saja dikerjakan model, token yang dihemat akan terkumpul di ribuan panggilan API. Skill manusia gua dapat diinstal dalam satu perintah melalui skills.sh dan bekerja secara global di seluruh proyek. Terlepas dari apakah itu membuat Claude sedikit kurang terampil berujar, itu sudah membuat banyak pengembang jauh lebih tidak kesal.