奥特曼豪宅连遭袭击,他还藏了一座地堡,AI叙事反噬创始人

OpenAI 的創辦人奧特曼週末连遭两起襲擊,十年前建好的懷俄明州地堡成为最后防線。

(前情提要:Sam Altman 幼年性侵妹妹疑雲,法官准許用兒童虐待法继续審理)

(背景補充:加州大学研究「AI 腦雾」现象:14% 上班族被 Agent、自动化搞瘋,离職意願高四成)

2016 年,山姆·奧特曼在懷俄明州地下建了一座地堡。1,200 平方米,三層結構,500 公斤黄金,5,000 片碘化鉀,5 噸凍幹食品,10 万发子彈。那一年,OpenAI 剛成立一週年。

十年之后,世界上最有權力的 AI 公司的掌门人,连续两个週末遭到襲擊,先是燃燒瓶,后是槍擊。他本人在部落格裡说,他嚴重低估了「敘事的力量」。他说的是別人的敘事,还是他自己的?

4 月 10 日凌晨 3 时 40 分,舊金山切斯納特街。一个 20 歲的男人,Daniel Moreno-Gama,將一隻燃燒瓶砸向山姆·奧特曼公寓的金屬大门。火勢引燃了外门附近,他随即逃离。约一小时后,同一人出现在 OpenAI 舊金山辦公室附近,继续威脅縱火,随即被捕。指控包括謀殺未遂和縱火。

山姆·奧特曼舊金山住所,及縱火嫌疑人監控影像

两天后,4 月 12 日凌晨 1 时 40 分,一輛本田轎车停在奧特曼位於俄羅斯山的另一處住所旁。车內乘客將手伸出窗外,向住所开了一槍。監控錄影記錄了车牌,警方随后逮捕两人:Amanda Tom(25 歲)和 Muhamad Tarik Hussein(23 歲)。搜查住所时发现三支槍,两人被控过失开槍罪。

一个週末,两起襲擊。

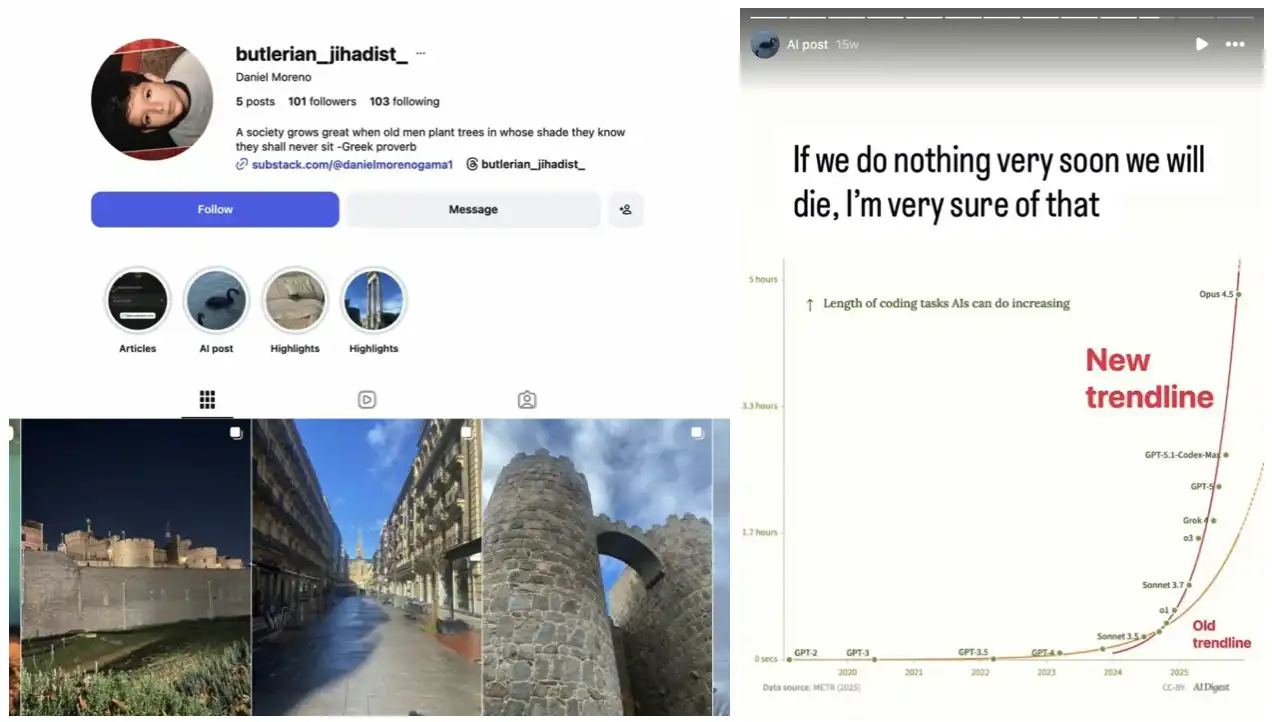

第一起案件的嫌疑人 Daniel Moreno-Gama 是位 AI 悲觀主義者。他在社交媒體上引用《沙丘》中人類对抗机器的主題,寫文章論证 AI 对齐失效構成存亡級风险,批評科技领袖为追求「超人類主義」而「拿全人類命运豪賭」。

他的論據是什麼?

过去五年,OpenAI 建構 AI 敘事的標準动作之一,就是反覆強调 AGI 的「存在級」威脅有多真实。为了让政府认真对待監管,为了让投资人理解这个賭注有多大,也为了让整个产业都意识到这场競賽不容错过。这套話语有它的功能,它让 OpenAI 在三件事上同时成立:前沿最危险、我們最负责任、所以资金应該給我們。

但「这是人類歷史上最危险的技術」这句話,发出去之后不会只停在科技圈和投资人那裡。它会向下傳導,在某些人那裡變成字面意義上的行动指令。Moreno-Gama 在 ins 分享裡寫,「指數級进步加上对齐失效,等於存亡风险」。这个論证框架的原始来源,是 AI 安全研究的主流文獻,其中很多由 OpenAI 资助或背书。

Daniel Moreno-Gama 社媒賬號

第一次襲擊后,奧特曼在部落格发文。他貼了一張与孩子的合照,说他希望这張照片能阻止下一个人向他家扔燃燒瓶。他承认反对者的「合法道義立场」,呼籲公共討論「在字面和比喻意義上都少一点爆炸性」。

他还在回应一篇《紐约客》深度报道。那篇文章就在襲擊前數天发布,公开质疑他作为 AI 最高權力掌控者的可信度。他寫道,「我嚴重低估了輿論敘事和言语的力量。」

两天后,他的住所又遭到槍擊。

这條軌跡的起点,比大多數人意识到的要早一年。

2024 年 12 月 4 日,紐约。UnitedHealthcare CEO Brian Thompson 在希爾頓酒店外被槍殺。嫌疑人 Luigi Mangione,常春藤名校畢业,留下了批判醫療保险产业的手寫宣告。案件在社交媒體上引发了一波不尋常的反应:大量普通使用者公开表达对兇手的同情,甚至把他捧成了某種反抗符號。

那一刻,有些门被推开了。

Thompson 案之后,高管安保这件事从「福利待遇」變成了「生存需求」。根據《财富》雜誌引用的调研资料,2023 年以来,針对大企业高管的人身犯罪襲擊比例增幅达 225%。標普 500 成分公司中,2025 年有 33.8% 在财报中报告了高管安全支出,2020 年这个數字是 23.3%。提供安保服務的公司,中位數成本为 13 万美元,同比增长 20%,五年內翻倍。

AI 产业是这个趨勢最新、最顯眼的接收端。十大科技巨头 CEO 2024 年安保支出總计超过 4,500 万美元。扎克伯格一人超过 2,700 万美元,高於蘋果、谷歌等四家 CEO 费用的總和。英偉达黄仁勳 2025 年为 350 万美元,同比增长 59%。谷歌皮查伊为 827 万美元,增长 22%。

AI 产业有个別的产业沒有的东西,那就是连建造者自己都相信,这項技術可能毀滅文明。皮尤研究中心 2025 年调查了全球 28,333 名受訪者,只有 16% 对 AI 发展感到興奮,34% 表示擔憂。更反直覺的发现是:受教育程度越高、收入越高,对 AI 失控的擔憂反而越強。懂得最多的人,最害怕它。

前不久,印第安納波利斯市议員 Ron Gibson 的住宅遭槍手在深夜连射 13 槍,他的 8 歲兒子被槍聲驚醒。门口留著一張手寫紙條,「不準建资料中心。」FBI 已介入调查。喬治华盛頓大学極端主義研究專案的研究員 Jordyn Abrams 指出,资料中心正在成为反科技、反政府極端分子的攻擊目標。

Ron Gibson 槍擊案现场

这種恐懼在产业內部不是秘密,只是不被大聲说出来。

奧特曼在懷俄明州建那座地堡是 2016 年。那一年,OpenAI 剛剛宣告成立,正在向全世界描繪 AI 將如何造福人類。两件事同时成立,他在臺上講 AI 是人類最大的机遇,在私下囤積足夠支撐一支武裝民兵的彈藥。

这是一種理性的雙重下注:公开押注 AI 会成功,私下準備 AI 会失控。

今年 2 月 27 日,OpenAI 与美国国防部簽署合同,允許五角大樓將 ChatGPT 部署於机密防務網路,使用範圍涵蓋「任何合法用途」。同一天,奧特曼还公开表示认同 Anthropic 对 AI 軍事应用的限制立场。随后 ChatGPT 單日解除安裝量激增 295%,一星評价 24 小时內增加 775%。QuitGPT 抵制运动據稱累计超过 150 万人參与。

3 月 21 日,约 200 名抗议者在舊金山遊行,橫跨 Anthropic、OpenAI 和 xAI,要求三家 CEO 承諾暫停前沿 AI 开发。同期,倫敦出现了迄今規模最大的反 AI 遊行。

奧特曼的懷俄明州地堡和他僱用的安保,針对的是两種不同的风险,一種来自外面的人,一種来自他自己正在建造的东西。他在私下认真对待这两種风险,在公开场合只承认其中一種。

第一次襲擊发生的同一週,《紐约客》刊发了一篇对奧特曼的深度报道。記者 Ronan Farrow 和 Andrew Marantz 採訪了逾 100 名知情人,核心論点只有两个字:不可信。报道援引一位前 OpenAI 董事会成員的話,稱奧特曼是「反社会人格」,「不受真相约束」。多位前同事描述他反覆改口关於 AI 安全的立场,在必要时重新定義權力結構。

奧特曼在博文裡回应时,承认自己有「衝突迴避」的傾向。奧特曼建構了「AI 是存在級威脅」的公共敘事,作为募资和監管博弈的工具。結果这个工具从他手裡飞了出去,繞了一圈,砸回了他的门上。

相关文章