Telegram запускає no-code інструменти для AI-ботів, що підтримують моделі GPT і Llama

За повідомленням Techiexpert від 27 квітня, Telegram запустив інструмент для створення AI-ботів без написання коду: користувачам не потрібні жодні навички програмування, щоб створити й розгорнути AI-бота лише за допомогою кліків. Новий інструмент підтримує різні AI-моделі, зокрема GPT та Llama, і інтегрований у Telegram Business.

Процес безкодового створення: бот LobsterFather та інтеграція з сторонніми платформами

(Джерело: Techiexpert)

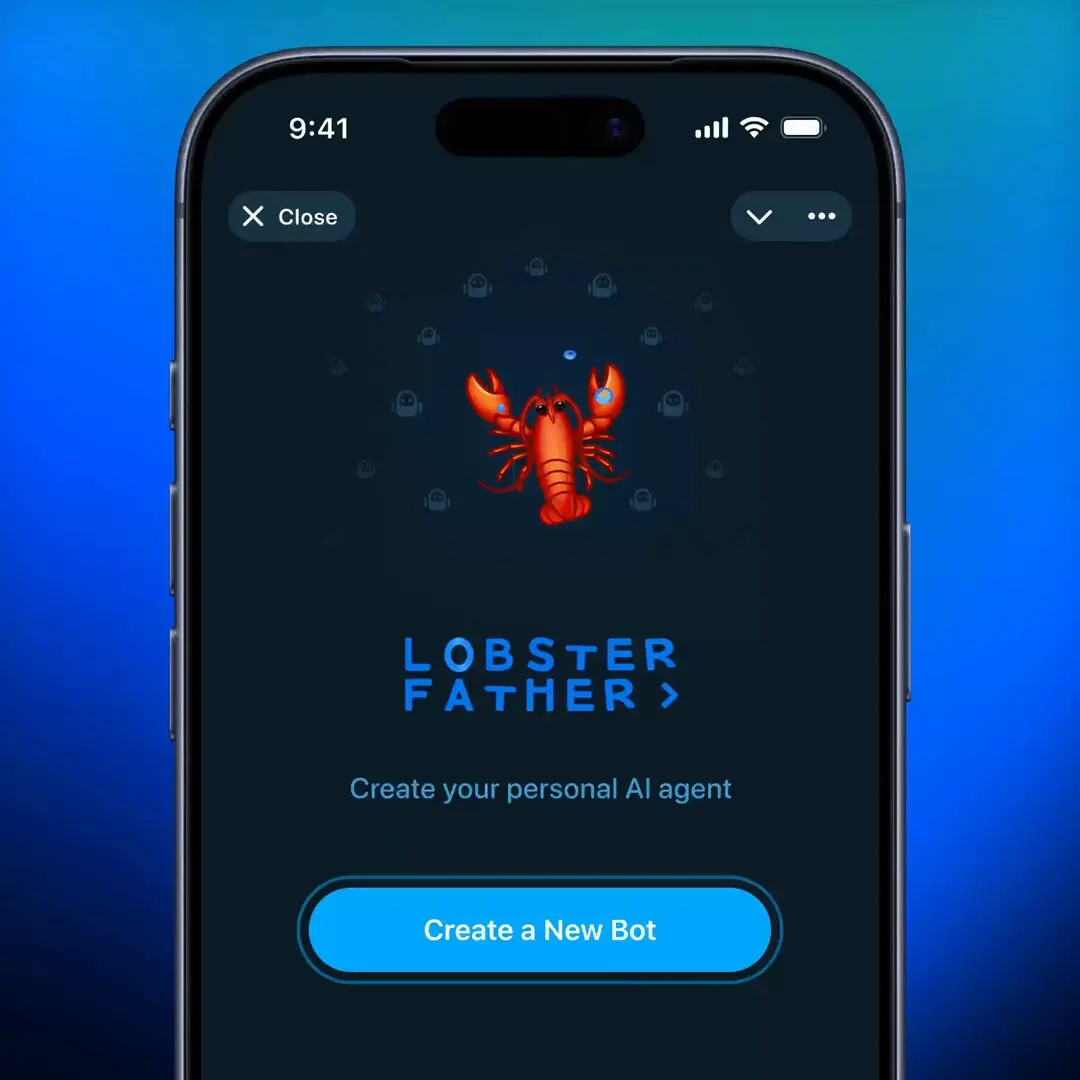

Згідно з повідомленням Techiexpert, процес створення складається з двох кроків: спочатку користувач взаємодіє з ботом LobsterFather на платформі Telegram, отримує ключ для нового проєкту (token); потім вводить ключ у сторонні платформи на кшталт Telewer, GPTBots або Lazy AI, щоб через вибір пунктів у списку налаштувати стиль діалогу та функції бота.

Підтримувані AI-моделі включають GPT та Llama; користувачі можуть налаштувати бота для виконання завдань на кшталт відповідей на запитання, керування групами або поширення інформації. Як зазначає Techiexpert, Telegram також одночасно запустив інтелектуальний текстовий редактор, який використовує AI-моделі, щоб допомогти користувачам переписувати або редагувати повідомлення.

Функція Master Bot: централізоване керування кількома дочірніми ботами

Згідно з повідомленням Techiexpert, однією з ключових нових функцій цього оновлення є Master Bot (головний бот). Користувачі можуть створити Master Bot, щоб централізовано керувати іншими дочірніми ботами та призначати кожному з них конкретні завдання; це підходить для сценаріїв, де потрібно одночасно обробляти кілька чат-груп або консультації клієнтів.

Ця функція інтегрована з Telegram Business: боти можуть автономно виконувати завдання 7x24 — вітати нових учасників, фільтрувати спам-повідомлення та відповідати на типові запитання — без необхідності ручного втручання користувача. У повідомленні Techiexpert зазначено, що користувачі можуть надати боту права на виконання конкретних завдань, не вимагаючи спільного використання приватних паролів або відмови від повного контролю над обліковим записом.

Зауваження щодо безпеки даних на сторонніх платформах

Згідно з повідомленням Techiexpert, під час використання наведених вище інструментів без коду дані користувачів обробляють сторонні платформи на кшталт Telewer, GPTBots і Lazy AI, а не напряму Telegram. Techiexpert зазначає, що користувачі мають перевірити безпекові налаштування кожної сторонньої платформи та підтвердити обсяг даних, якими користувач ділиться з сторонніми розробниками. На момент публікації цього матеріалу Telegram офіційно не надав конкретних пояснень щодо заходів безпеки даних для вищезазначених сторонніх платформ.

Поширені запитання

Як працюють інструменти безкодових AI-ботів Telegram?

Згідно з повідомленням Techiexpert від 27 квітня 2026 року, користувачі мають спочатку взаємодіяти з ботом LobsterFather, щоб отримати ключ (token), а потім під’єднати його до сторонніх платформ, таких як Telewer, GPTBots або Lazy AI, і через вибір опцій налаштувати функції бота та стиль діалогу — уся процедура виконується без написання коду.

Для чого саме призначена функція Master Bot і для яких сценаріїв вона підходить?

Згідно з повідомленням Techiexpert, функція Master Bot дозволяє користувачам створити головного бота, централізовано керувати ним і розподіляти завдання між кількома дочірніми ботами. Вона підходить для сценаріїв, коли потрібно одночасно керувати кількома Telegram-групами або обробляти звернення клієнтів; ця функція вже інтегрована в Telegram Business.

Які зауваження щодо безпеки даних є при створенні ботів за допомогою сторонніх безкодових платформ?

Згідно з повідомленням Techiexpert, під час використання сторонніх платформ на кшталт Telewer, GPTBots або Lazy AI дані користувача обробляють відповідні сторонні платформи. Користувачам слід перевірити безпекові налаштування та умови спільного використання даних кожної платформи; Telegram офіційно не надав додаткових пояснень щодо заходів безпеки інформації для вищезазначених сторонніх платформ.

Пов'язані статті

Міністр закордонних справ Сінгапуру розгортає власний ШІ-асистент на Raspberry Pi з використанням Claude Code

Індійські платформи електронної комерції запускають AI-вітрини для ChatGPT, Perplexity та Gemini

Індія запускає проєкт $650M AI-міста в Бангалорі, орієнтований на 25 000 дослідників до 2030 року

OpenAI Рекрутує найкращі таланти з корпоративного софту, оскільки агенти на передньому краї змінюють індустрію

Worxphere перейменовує JobKorea, додаючи інструменти для найму на базі ШІ

AI-агент уже здатний самостійно відтворювати складні академічні статті: Mollick стверджує, що помилки здебільшого трапляються в людських оригіналах, а не в AI