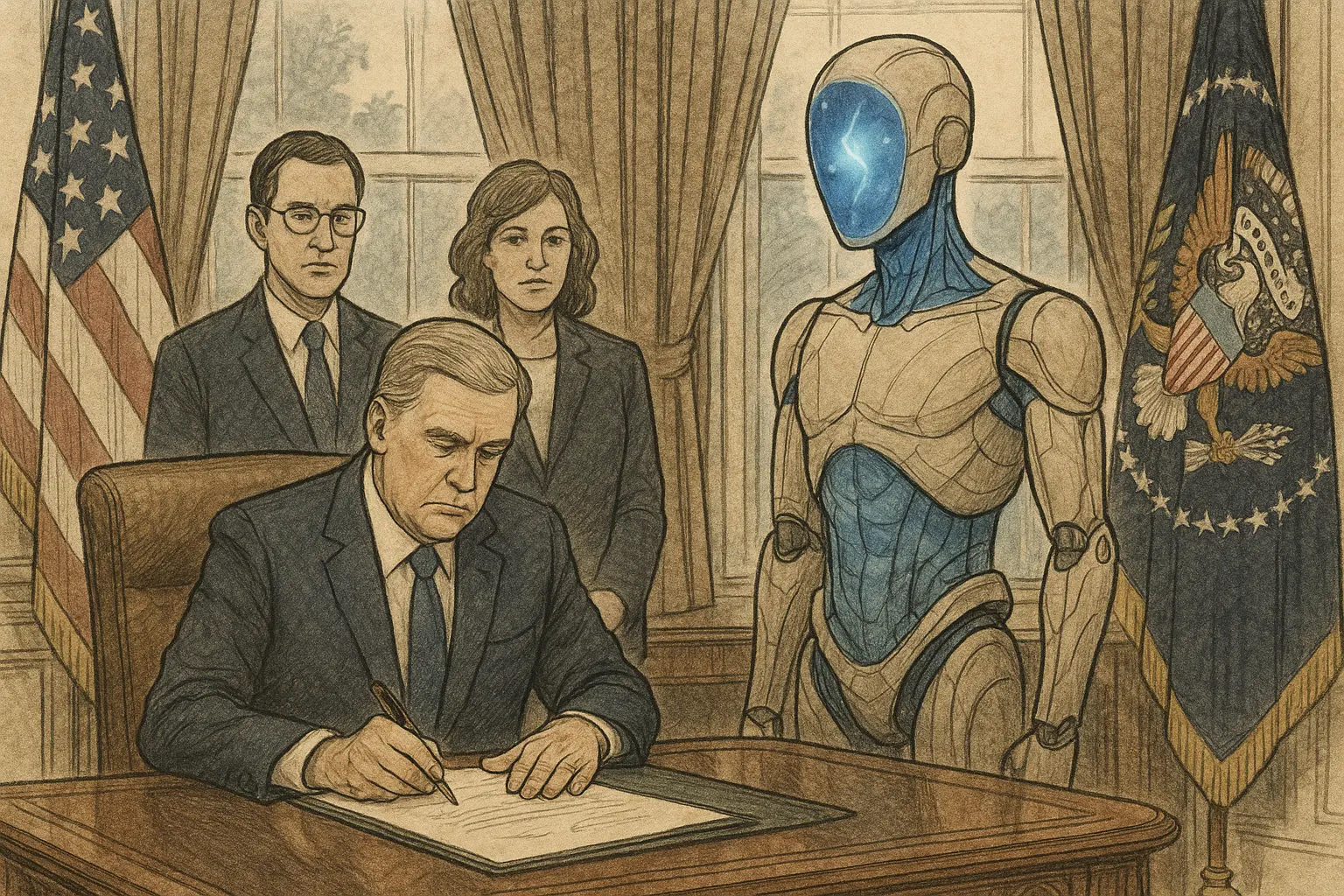

Mídia americana: rascunho de ordem executiva da Casa Branca permite que o modelo Anthropic Mythos entre no governo

De acordo com uma matéria da Axios, citando pessoas com conhecimento do assunto em 28 de abril, a Casa Branca está desenvolvendo diretrizes para permitir que agências federais contornem a determinação de risco de cadeia de suprimentos (SCRD) da Anthropic e introduzam novos modelos para uso do governo, incluindo o modelo Mythos, da Anthropic. A esse respeito, a Casa Branca divulgou uma declaração oficial dizendo que quaisquer declarações de política serão publicadas diretamente pelo presidente, e que qualquer outra versão dos fatos é pura especulação.

Contato recente da Casa Branca e medidas propostas

De acordo com a matéria da Axios de 28 de abril, no início deste mês, o chefe de gabinete da Casa Branca, Susie Wiles, e o secretário do Tesouro, Scott Bessent, se reuniram conjuntamente com o CEO da Anthropic, Dario Amodei. Ambos descreveram a reunião como um encontro introdutório produtivo, discutindo direções de cooperação entre a empresa e o governo.

Nesta semana, a Casa Branca reuniu empresas de diversos setores para obter informações sobre possíveis medidas administrativas e melhores práticas para a implantação do sistema Mythos. Segundo a matéria da Axios, as reuniões envolviam “leitura de roteiro” (table reads) das diretrizes propostas; tais diretrizes podem derrubar a instrução anterior do Office of Management and Budget (OMB) de que departamentos governamentais não devem usar sistemas da Anthropic. A Anthropic não quis comentar a respeito da matéria correspondente da Axios.

Contexto da disputa: determinação de risco de cadeia de suprimentos e processo legal no Pentágono

De acordo com a matéria da Axios de 28 de abril, o Departamento de Defesa (DoD) havia emitido previamente determinações de risco de cadeia de suprimentos sobre a Anthropic e moveu uma ação judicial no tribunal. O cerne da controvérsia está no fato de a Anthropic ter se recusado a assinar um acordo que permitiria que o Pentágono usasse o modelo Claude sob o padrão de “todos os usos legais” (que abrange aplicações em drones). As cláusulas de proibição explícitas da Anthropic incluem vigilância interna em larga escala e o desenvolvimento de armas totalmente autônomas. O Pentágono afirmou que a recusa da Anthropic mostra que ela não é uma parceira confiável.

De acordo com a matéria da Axios, apesar de o processo legal continuar, as agências governamentais, incluindo o Pentágono, ainda conseguem usar parte dos modelos da Anthropic. A Agência de Segurança Nacional dos EUA (NSA) também está usando o Mythos. No entanto, atualmente o Pentágono ainda segue os termos de serviço antigos que ambos consideram demasiado rígidos e não consegue obter a versão mais recente das atualizações dos modelos da Anthropic.

A posição central da Anthropic e comparação com o setor

De acordo com a matéria da Axios de 28 de abril, a Anthropic insiste em recusar a assinatura de um acordo de “todos os usos legais”, proibindo de forma explícita finalidades que incluem vigilância interna em larga escala e o desenvolvimento de armas totalmente autônomas.

A matéria da Axios também afirma que OpenAI e Google já firmaram acordos com o Pentágono, permitindo que, em ambientes confidenciais, seus modelos sejam usados de acordo com o padrão de “todos os usos legais”. Ambas as empresas afirmam que os acordos em questão respeitam as duas cláusulas de proibição estabelecidas pela Anthropic.

Perguntas frequentes

Qual é o conteúdo específico das diretrizes relacionadas à Anthropic que a Casa Branca pretende formular?

De acordo com a matéria da Axios de 28 de abril, citando pessoas com conhecimento do assunto, a Casa Branca está elaborando diretrizes que permitem que agências federais contornem a determinação de risco de cadeia de suprimentos da Anthropic. As medidas podem ser divulgadas na forma de uma ordem executiva e incluem diretrizes para a implantação do modelo Mythos. A declaração oficial da Casa Branca diz que quaisquer declarações de política serão publicadas diretamente pelo presidente.

Qual é a causa fundamental da disputa entre o Pentágono e a Anthropic?

De acordo com a matéria da Axios de 28 de abril, a disputa surgiu do fato de a Anthropic ter se recusado a assinar um acordo que permitiria que o Pentágono usasse o modelo Claude sob o padrão de “todos os usos legais”, proibindo explicitamente usos que incluem vigilância interna em larga escala e o desenvolvimento de armas totalmente autônomas. Em seguida, o Pentágono emitiu uma determinação de risco de cadeia de suprimentos e moveu um processo legal.

Qual é a posição da OpenAI e do Google sobre o mesmo assunto?

De acordo com a matéria da Axios de 28 de abril, tanto a OpenAI quanto o Google já firmaram acordos com o Pentágono, permitindo que, em ambientes confidenciais, seus modelos sejam usados de acordo com o padrão de “todos os usos legais”. Além disso, as duas empresas afirmam que os acordos respeitam as duas cláusulas de proibição estabelecidas pela Anthropic.

Related Articles

Modelo Ling-2.6-flash da Ant Group disponibilizado como código aberto: 104B de parâmetros com 7,4B ativos, alcança múltiplos benchmarks SOTA

Sam Altman publica capturas de tela do Codex em dois modos, com as funções de escritório e programação oficialmente separadas

O Codex da OpenAI lança interface de dois modos: Excelmogging para trabalho de escritório, Codemaxxing para programação

Taylor Swift solicita marcas registradas de voz e imagem para se proteger contra a disseminação de conteúdo falsificado por IA

Casa Branca Redige Orientação para Permitir o Uso da Anthropic e Dispensar Determinações de Risco da Cadeia de Suprimentos