3.8 Estrategia nocturna de Bitcoin y Ethereum!

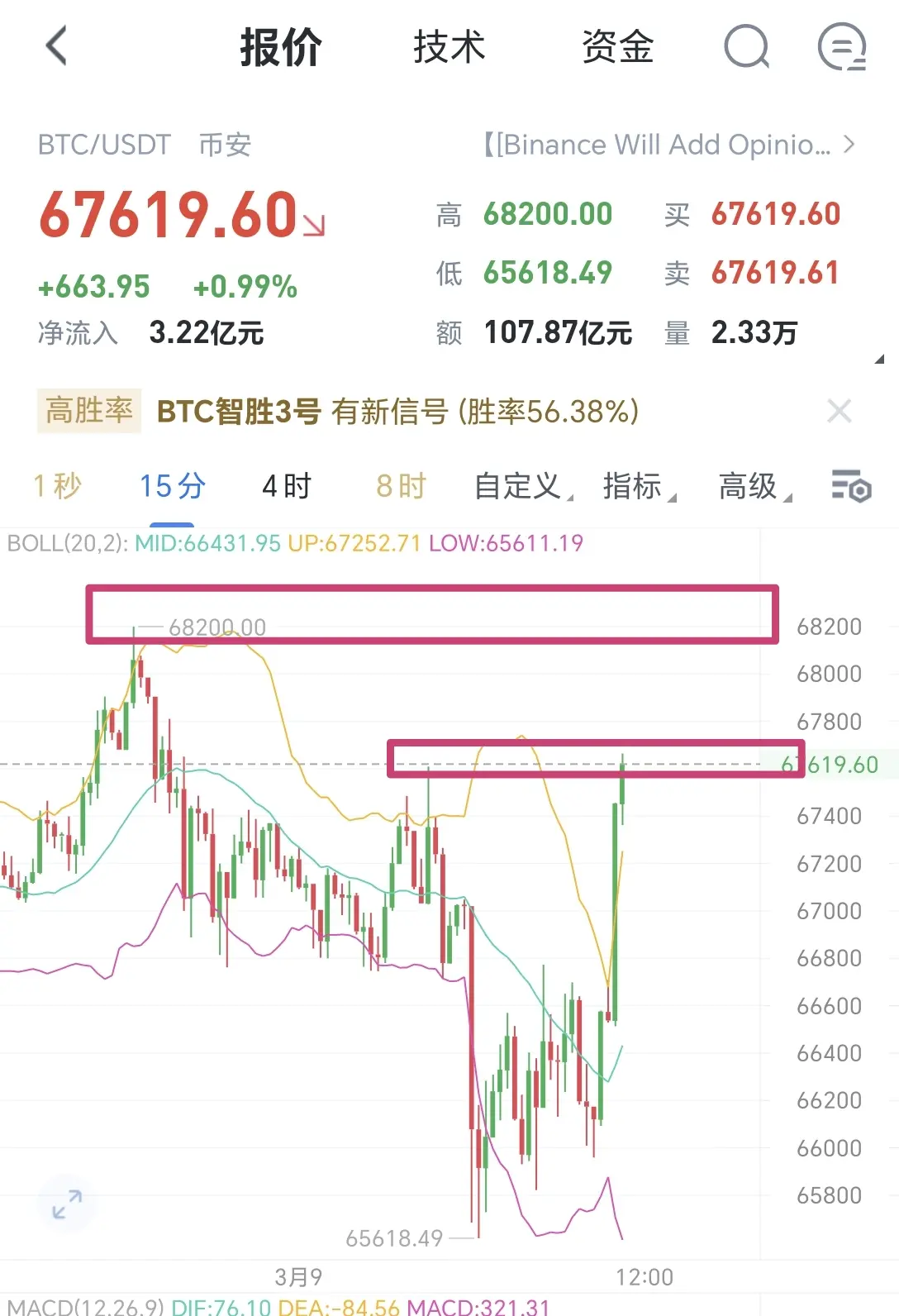

Bitcoin 66300-66800 en largo, objetivo 68000-69000, protección 65500!

Ethereum 1910-1930 en largo, objetivo 1980-2040, protección 1880!

¡La estrategia tiene vigencia limitada, el detalle se confirmará con la orientación en tiempo real privada!#2月非农意外负增长 #加密市场小幅下跌 #原油价格飙升

Bitcoin 66300-66800 en largo, objetivo 68000-69000, protección 65500!

Ethereum 1910-1930 en largo, objetivo 1980-2040, protección 1880!

¡La estrategia tiene vigencia limitada, el detalle se confirmará con la orientación en tiempo real privada!#2月非农意外负增长 #加密市场小幅下跌 #原油价格飙升